Hướng dẫn quản lý AI agent permission để đảm bảo an toàn hệ thống

Việc tích hợp AI Agent vào hệ thống mang lại giá trị lớn, nhưng cũng tạo ra lỗ hổng bảo mật nghiêm trọng nếu không có cơ chế phân quyền (Authorization) chặt chẽ. Bài viết này sẽ giúp các đội ngũ kỹ thuật hiểu cách thiết lập và quản lý AI agent permission chỉ truy cập dữ liệu mà người dùng có quyền xem và đảm bảo tuân thủ các tiêu chuẩn bảo mật doanh nghiệp.

Những điểm chính

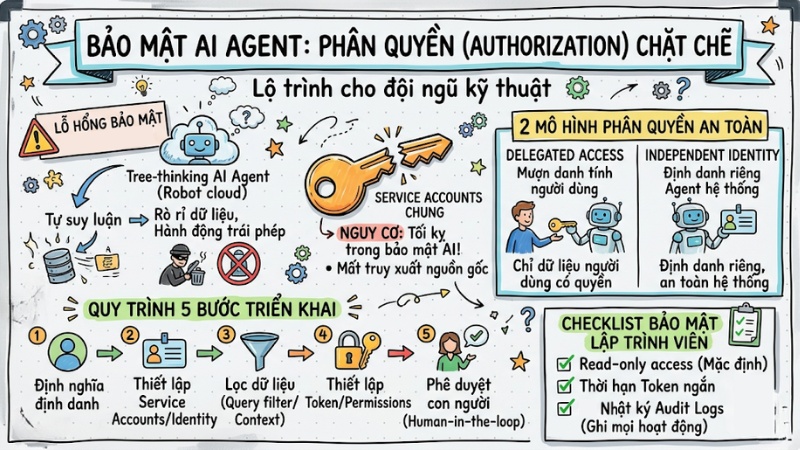

- Lý do AI Agent cần phân quyền riêng biệt: Nhận diện rủi ro từ khả năng tự suy luận của AI, giúp ngăn chặn rò rỉ dữ liệu và các hành động trái phép ngoài tầm kiểm soát.

- Nguy cơ từ Service Accounts: Hiểu lý do tại sao tài khoản dịch vụ chung là "tối kỵ" trong bảo mật AI và các hệ lụy về việc mất khả năng truy xuất nguồn gốc.

- Mô hình phân quyền an toàn: Nắm vững hai mô hình ưu việt là Delegated Access (mượn danh tính người dùng) và Independent Identity (định danh riêng cho Agent hệ thống).

- Quy trình triển khai 5 bước: Quy trình chuẩn để thiết lập hệ thống từ định nghĩa định danh, lọc dữ liệu đến cơ chế phê duyệt của con người (Human-in-the-loop).

- Checklist bảo mật cho lập trình viên: Danh sách kiểm tra nhanh các yếu tố như quyền truy cập Read-only, thời hạn token và nhật ký truy cập (Audit Logs).

- Giải đáp thắc mắc: Làm rõ các khái niệm nâng cao như JIT Access, Permission Mirroring và cách dùng công cụ tập trung để quản lý bảo mật AI hiệu quả.

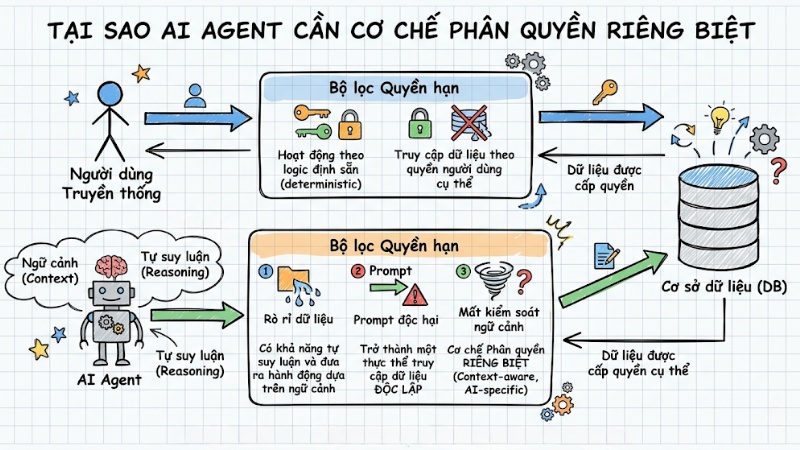

Tại sao AI Agent cần cơ chế phân quyền riêng biệt?

Khác với phần mềm truyền thống hoạt động theo logic cố định (deterministic) AI Agent có khả năng tự suy luận và đưa ra hành động dựa trên ngữ cảnh. Khi Agent được cấp quyền gọi API hoặc truy vấn cơ sở dữ liệu (DB), nó trở thành một thực thể có khả năng truy cập dữ liệu độc lập

Các rủi ro chính:

- Rò rỉ dữ liệu: Agent có thể truy cập toàn bộ DB và trả về thông tin nhạy cảm (như lương nhân viên hoặc chiến lược của công ty mà người dùng hiện tại không có quyền truy cập.

- Thực hiện hành động trái phép: Nếu Agent được cấp quyền thực thi (như gửi email, xóa record), một prompt độc hại có thể điều khiển Agent thực hiện các hành động ngoài phạm vi công việc

- Mất kiểm soát ngữ cảnh: Agent có thể bị lừa bởi "prompt injection" (tấn công thông qua câu lệnh) khiến nó bỏ qua các nguyên tắc an toàn đã thiết lập

AI Agent cần cơ chế phân quyền riêng biệt

Rủi ro của việc lạm dụng Service Accounts

Nhiều hệ thống sử dụng "Service Account" (tài khoản dịch vụ) có quyền hạn rộng cho mọi AI Agent. Đây là cách làm tối kỵ vì:

- Vi phạm nguyên tắc Least Privilege: Agent có nhiều quyền hơn mức cần thiết để thực hiện nhiệm vụ.

- Mất khả năng truy xuất: Mọi hành động đều được ghi nhận dưới tên tài khoản chung, khiến việc xác định người gây ra lỗi trở nên bất khả thi.

- Nguy cơ leo thang đặc quyền: Một khi Service Account bị chiếm quyền, toàn bộ dữ liệu hệ thống sẽ bị lộ.

Mô hình quản lý AI Agent Permissions an toàn

Để vận hành an toàn, bạn nên cân nhắc hai mô hình cấp quyền an toàn cho AI Agent sau:

Delegated Access (Permission Mirroring)

Delegated Access (Permission Mirroring) là một phương pháp được khuyến nghị mạnh mẽ và an toàn để phân quyền cho AI agent. Lúc này, Agent không sử dụng danh tính riêng mà "mượn" danh tính (token) của người dùng hiện tại.

- Cách hoạt động: Khi người dùng tương tác, token của họ được đính kèm vào yêu cầu của Agent. Mọi tài nguyên mà Agent truy vấn sẽ được kiểm tra dựa trên quyền hạn của token người dùng

- Lợi ích: Đảm bảo Agent "thấy" đúng những gì người dùng được phép thấy. Nếu người dùng không được phép xem bản ghi A, Agent cũng sẽ bị từ chối truy cập

Independent Identity (Dành cho Agent hệ thống)

Áp dụng cho các Agent chạy nền (không có sự hiện diện trực tiếp của người dùng).

- Cách hoạt động: Cấp cho mỗi Agent một định danh riêng qua OAuth/OIDC với các Scopes (phạm vi truy cập) cụ thể như

read:documentshoặcno:delete. - Lợi ích: Kiểm soát chặt chẽ phạm vi hoạt động của Agent mà không phụ thuộc vào một user cụ thể nào.

| Tiêu chí | Service Account | Delegated Access |

|---|---|---|

| Bảo mật | Thấp (quyền hạn quá mức) | Cao (dựa trên quyền user) |

| Truy xuất | Khó | Dễ dàng |

| Độ phức tạp | Thấp | Trung bình |

Quy trình triển khai AI Agent Permissions

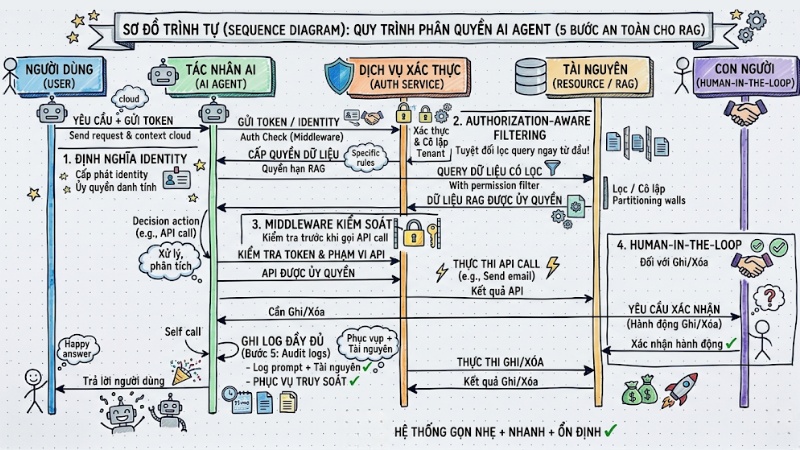

Về quy trình triển khai quyền hạn cho AI Agent, Bạn thực hiện theo 5 bước sau để đảm bảo an toàn cho hệ thống RAG (Retrieval-Augmented Generation):

- Định nghĩa Identity: Cấp phát định danh riêng biệt cho Agent hoặc sử dụng cơ chế ủy quyền danh tính người dùng.

- Authorization-aware Filtering: Khi Agent tìm kiếm dữ liệu (Vector DB/Documents), hãy áp dụng bộ lọc quyền hạn ngay từ bước truy vấn (query). Tuyệt đối không lấy dữ liệu rồi mới lọc sau.

- Middleware kiểm soát: Bạn hãy chèn một lớp middleware giữa Agent và các API bên ngoài. Lớp này có nhiệm vụ kiểm tra token và phạm vi quyền hạn trước khi cho phép thực thi.

- Human-in-the-loop: Đối với các hành động "Write" hoặc "Delete", bạn hãy luôn yêu cầu sự xác nhận từ con người.

- Audit Logs: Ghi lại mọi yêu cầu từ Agent, bao gồm cả nội dung prompt gửi đi và tài nguyên được truy cập.

Quy trình triển khai AI Agent Permissions

Checklist kiểm tra AI Agent Permissions nhanh cho lập trình viên

Khi đã hiểu rõ ưu nhược điểm của từng mô hình, bạn có thể dùng checklist dưới đây để chọn kiến trúc triển khai phù hợp với bối cảnh và yêu cầu của mình:

- Agent có đang sử dụng quyền "Read-only" tối đa không?

- Dữ liệu trả về có được lọc theo quyền của User không?

- Tất cả các hành động nhạy cảm đã có bước xác nhận của con người chưa?

- Token sử dụng cho Agent có thời gian tồn tại ngắn (short-lived) không?

- Hệ thống đã log lại toàn bộ lịch sử truy cập của Agent chưa?

Giải đáp thắc mắc thường gặp (FAQ) liên quan đến AI agent permissions

Permission Mirroring (Phản chiếu quyền hạn) là gì?

Permission mirroring là cơ chế đảm bảo AI Agent chỉ được phép truy cập những dữ liệu mà người dùng đang tương tác với nó có quyền xem.

Just-in-time (JIT) Access là gì?

Just-in-time (JIT) Acces là việc cấp quyền truy cập tạm thời cho Agent ngay tại thời điểm thực hiện tác vụ và thu hồi ngay sau đó, giúp giảm thiểu rủi ro bị đánh cắp credentials.

Làm sao để ngăn chặn Agent hành động sai?

Bạn sử dụng Behavioral Guardrails (Ràng buộc hành vi) để giám sát hành vi nếu Agent có dấu hiệu bất thường (như tải dữ liệu hàng loạt vào khung giờ lạ), hệ thống sẽ tự động vô hiệu hóa quyền truy cập.

Cần dùng công cụ nào để quản lý?

Bạn có thể sử dụng các giải pháp như Cerbos hoặc Oso để quản lý chính sách phân quyền tập trung, giúp tách biệt logic bảo mật ra khỏi code của Agent.

Tại sao AI agent cần quản lý quyền truy cập riêng biệt?

AI agent hoạt động theo cách không xác định, có thể thực hiện hành động ngoài ý định của người dùng. Nếu không có phân quyền, agent có thể truy cập dữ liệu nhạy cảm hoặc thực hiện thay đổi trái phép, gây rủi ro rò rỉ dữ liệu và vi phạm quy định.

Service accounts có rủi ro gì khi cấp quyền cho AI agent?

Sử dụng service accounts chung cho AI agent vi phạm nguyên tắc đặc quyền tối thiểu (least privilege). Điều này dẫn đến việc agent có quyền truy cập quá rộng, khó khăn trong việc truy xuất nguồn gốc hành động và tăng nguy cơ lạm dụng.

Mô hình "Delegated Access" hoạt động như thế nào cho AI agent?

Delegated Access cho phép AI agent sử dụng token của người dùng để thực hiện hành động. Agent chỉ có quyền hạn tương đương với người dùng đã gọi nó, đảm bảo chỉ truy cập được những dữ liệu mà người dùng đó được phép xem.

Thế nào là Independent Identity cho AI agent?

Independent Identity là khi AI agent có ID riêng biệt và được cấp các scopes (phạm vi truy cập) cụ thể, ví dụ read_only, thay vì kế thừa quyền từ người dùng. Điều này phù hợp cho các agent chạy ngầm hoặc xử lý tác vụ hệ thống.

Làm thế nào để triển khai quyền hạn an toàn cho AI agent?

Triển khai quyền hạn an toàn cho AI agent bằng cách áp dụng nguyên tắc ít đặc quyền, sử dụng OAuth scopes, cấp token có thời hạn ngắn, thiết lập ghi nhật ký kiểm toán chi tiết và cân nhắc "human-in-the-loop" cho các hành động nhạy cảm.

"Authorization-aware Filtering" trong RAG là gì?

Đây là kỹ thuật kiểm tra quyền truy cập của người dùng trước khi thực hiện quá trình Embedding và Retrieval trong hệ thống RAG. Nó đảm bảo AI agent chỉ truy xuất và xử lý dữ liệu mà người dùng được phép.

"Human-in-the-loop" có ý nghĩa gì trong cấp quyền cho AI agent?

Human-in-the-loop yêu cầu sự phê duyệt của con người trước khi AI agent thực hiện các hành động quan trọng, nhạy cảm hoặc có thể gây hậu quả nghiêm trọng, như thay đổi dữ liệu hoặc xóa tệp.

Just-in-Time (JIT) Access giúp bảo vệ AI agent như thế nào?

JIT Access cấp quyền truy cập tạm thời, chỉ kéo dài trong thời gian cần thiết để hoàn thành một tác vụ. Sau khi tác vụ kết thúc, quyền truy cập này sẽ bị thu hồi ngay lập tức.

Tại sao cần ghi nhật ký kiểm toán (Audit logs) cho AI agent?

Nhật ký kiểm toán ghi lại mọi hành động của AI agent, bao gồm ai đã truy cập tài nguyên nào, khi nào và bằng danh tính nào. Điều này cực kỳ quan trọng cho việc điều tra sự cố, tuân thủ quy định và phát hiện hành vi bất thường.

AI agent có thể có ít quyền hơn người dùng gọi nó không?

Có, nguyên tắc ít đặc quyền cho phép bạn giới hạn quyền hạn của AI agent chỉ ở mức cần thiết để thực hiện nhiệm vụ, ngay cả khi người dùng gọi nó có nhiều quyền hơn.

Xem thêm:

- Hướng dẫn triển khai hệ thống OpenClaw Multi-Agent chi tiết

- MCP Server Best Practices: Tối ưu hóa hiệu suất cho AI Agents

- Hướng dẫn thiết lập Claude Code MCP: Tối ưu AI Coding Agent

Tóm lại, việc thiết lập và quản lý AI Agent Permission là nền tảng bắt buộc nếu bạn muốn tận dụng sức mạnh AI mà vẫn giữ vững an toàn hệ thống và dữ liệu doanh nghiệp. Bằng cách thiết kế AI Agent Permission theo nguyên tắc ít đặc quyền, ưu tiên Delegated Access hoặc Independent Identity, kết hợp lọc dữ liệu theo quyền, human‑in‑the‑loop và audit logs chặt chẽ, bạn sẽ biến AI Agent thành một thành phần đáng tin cậy trong kiến trúc bảo mật tổng thể thay vì trở thành điểm yếu mới.