AI Agent Observability: Cách giám sát hệ thống AI Agent cho doanh nghiệp

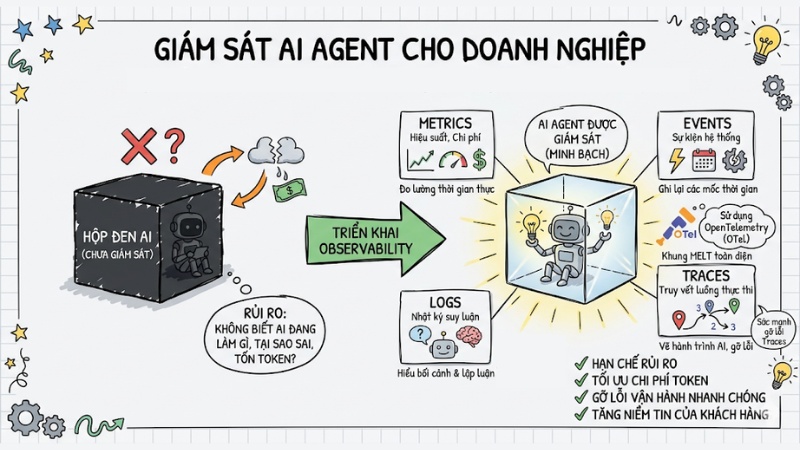

Khởi chạy một AI Agent vào quy trình kinh doanh giống như việc thuê một nhân viên xuất sắc nhưng không bao giờ báo cáo tiến độ. Khi AI tự động đưa ra quyết định thay vì chỉ trả lời câu hỏi, hệ thống sẽ trở thành một "hộp đen" tiềm ẩn rủi ro. Bạn không biết AI đang tiêu tốn bao nhiêu tài nguyên, sử dụng công cụ nào, hay tại sao lại đưa ra một quyết định sai lầm. Bài viết này giúp bạn giải quyết bài toán đó bằng cách thiết lập một hệ thống giám sát minh bạch, chuyển hóa rủi ro thành lợi thế cạnh tranh.

Những điểm chính

- Vượt qua "hộp đen" AI: Hiểu tại sao các công cụ giám sát hiệu suất (APM) truyền thống thất bại trước bản chất tự quyết định của AI Agent và nhu cầu cấp thiết về hệ thống Observability chuyên biệt.

- 3 rủi ro cốt lõi khi thiếu giám sát: Nhận diện hậu quả từ việc thiếu nhật ký kiểm toán (vi phạm pháp lý), khó khăn trong gỡ lỗi vận hành và sự sụt giảm niềm tin của khách hàng.

- Tiêu chuẩn vàng MELT: Nắm vững khung đo lường dữ liệu toàn diện bao gồm: Metrics (hiệu suất/chi phí), Events (sự kiện hệ thống), Logs (nhật ký suy luận) và Traces (truy vết luồng thực thi).

- Sức mạnh của Traces trong gỡ lỗi: Khám phá kỹ thuật quan trọng nhất giúp truy vết hành trình của AI qua các nhánh rẽ bất định, từ đó tìm ra nguyên nhân gốc rễ của mọi lỗi vận hành.

- Chiến lược OpenTelemetry (OTel): Học cách sử dụng chuẩn hóa dữ liệu OTel để xây dựng hệ thống giám sát linh hoạt, không phụ thuộc vào nhà cung cấp và dễ dàng mở rộng.

- Lộ trình 5 bước triển khai: Áp dụng quy trình thực tế từ việc xác định mục tiêu kinh doanh, chuẩn hóa thu thập dữ liệu đến xây dựng vòng lặp phản hồi giúp AI ngày càng thông minh hơn.

- Giải đáp thắc mắc (FAQ): Giải mã các rào cản kỹ thuật về đạo đức AI, quản lý memory cho Multi-agent và cách tối ưu chi phí thông qua việc theo dõi token thời gian thực.

Giới thiệu chung về AI Agent Observability

AI Agent và AI Agent Observability là gì?

AI Agent là các ứng dụng AI có khả năng tự suy luận, lập kế hoạch và sử dụng các công cụ bên ngoài (API, cơ sở dữ liệu) để hoàn thành một mục tiêu phức tạp mà không cần con người can thiệp từng bước.

AI Agent Observability là quá trình thu thập và phân tích dữ liệu đo lường từ xa (telemetry) để hiểu rõ toàn bộ hành vi của hệ thống AI Agent tự trị. Từ đó, bạn biết được hệ thống đang tương tác với LLM (Mô hình ngôn ngữ lớn) và các công cụ bên ngoài ra sao.

Mẹo thực chiến: Monitoring cho biết hệ thống đang gặp lỗi. Observability cho biết chính xác nguyên nhân xảy ra lỗi.

Sự khác biệt giữa phần mềm truyền thống và hệ thống AI Agent

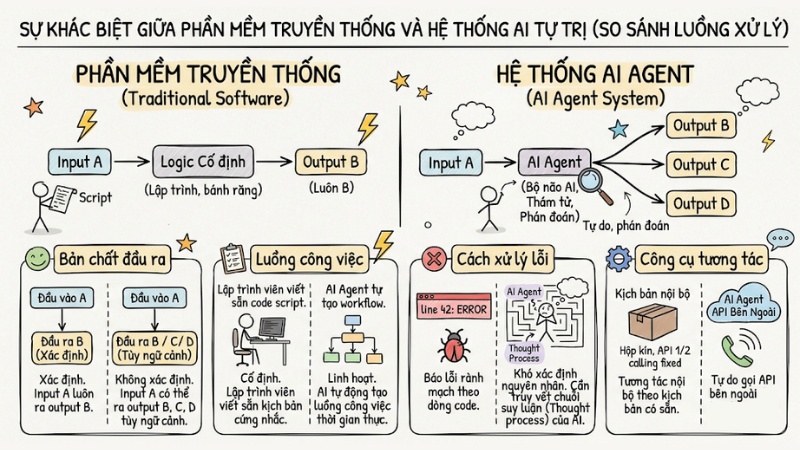

Các phương pháp MLOps (Vận hành học máy) hay giám sát hệ thống phân tán cũ không còn hiệu quả với AI Agent. Nguyên nhân nằm ở bản chất đầu ra, cụ thể như sau:

| Tiêu chí | Phần mềm truyền thống | Hệ thống AI Agent |

|---|---|---|

| Bản chất đầu ra | Xác định (Đầu vào A luôn ra đầu ra B). | Không xác định (Đầu vào A có thể ra B, C, D tùy ngữ cảnh). |

| Luồng công việc | Cố định, được lập trình viên viết sẵn. | Linh hoạt, do AI tự động tạo ra theo thời gian thực. |

| Cách xử lý lỗi | Thông báo lỗi rõ ràng theo dòng code. | Khó xác định nguyên nhân (cần truy vết chuỗi suy luận của AI). |

| Công cụ tương tác | Tương tác nội bộ theo kịch bản có sẵn. | Tự do gọi API bên ngoài dựa trên phán đoán của AI. |

So sánh luồng xử lý tuyến tính của phần mềm truyền thống và luồng xử lý đa nhánh, tự quyết định của AI Agent

Tại sao doanh nghiệp bắt buộc phải triển khai AI Agent Observability?

3 rủi ro cốt lõi khi hệ thống AI thiếu khả năng quan sát

Khi triển khai AI Agent vào thực tế, bạn đang trao quyền quyết định cho một cỗ máy. Nếu không có khả năng quan sát, bạn sẽ đối mặt với 3 rủi ro chí mạng như sau:

- Vi phạm tuân thủ và pháp lý: AI Agent thường xử lý dữ liệu nhạy cảm. Nếu thiếu nhật ký kiểm toán quyết định (Decision Audit Logs), doanh nghiệp không thể giải trình cách AI đưa ra kết luận trước các cơ quan quản lý.

- Lỗi vận hành không thể khắc phục: Khi một quy trình tự động bị hỏng, việc thiếu dữ liệu khiến đội ngũ kỹ thuật không thể thực hiện phân tích nguyên nhân gốc rễ khiến các lỗi sẽ liên tục lặp lại.

- Xói mòn niềm tin của khách hàng: Khách hàng sẽ rời bỏ bạn nếu AI tự ý đưa ra các quyết định sai lệch, ảo giác hoặc gây thiệt hại tài chính mà không có cơ chế giải thích rõ ràng.

Thách thức đặc thù trong hệ thống Multi-agent

Trong hệ thống Multi-agent (nhiều tác tử AI làm việc cùng nhau), độ phức tạp tăng lên theo cấp số nhân khi các AI phải đàm phán và giao việc cho nhau. Nếu không giám sát, một AI có thể yêu cầu thông tin sai từ AI khác, tạo ra một vòng lặp vô tận (infinite loop) làm sập hệ thống và cạn kiệt ngân sách API chỉ trong vài phút.

Khung dữ liệu MELT: Top 12 chỉ số cốt lõi cho AI Agent Observability

Để phá vỡ hộp đen, mình khuyên bạn áp dụng khung dữ liệu MELT. Đây là tiêu chuẩn vàng trong AI Agent Observability.

Metrics (Các chỉ số hiệu suất)

Metrics giúp bạn đánh giá sức khỏe tổng thể và chi phí vận hành của ứng dụng LLM.

- Token usage (Lượng Token sử dụng): Đo lường số lượng token đầu vào/đầu ra. Chỉ số này quyết định trực tiếp đến hóa đơn API hàng tháng của bạn.

- Inference Latency (Độ trễ suy luận): Thời gian từ khi người dùng đặt câu hỏi đến khi AI hoàn thành hành động. Độ trễ cao sẽ ảnh hướng trực tiếp đến trải nghiệm người dùng (UX).

- Model drift (Sự trôi dạt mô hình): Theo dõi sự suy giảm chất lượng của câu trả lời theo thời gian sẽ giúp bạn biết khi nào cần đánh giá và tinh chỉnh lại AI.

Events (Các sự kiện hệ thống quan trọng)

Sự kiện ghi lại các cột mốc quan trọng khi AI cố gắng hoàn thành một nhiệm vụ.

- API & LLM calls: Ghi lại mọi lệnh gọi đến mô hình ngôn ngữ hoặc cơ sở dữ liệu bên ngoài.

- Failed tool calls (Lỗi gọi công cụ): Cực kỳ quan trọng. Sự kiện này cho biết AI đang sử dụng sai cú pháp khi cố gắng gọi một công cụ (ví dụ: truyền sai định dạng ngày tháng vào API thời tiết).

- Human handoff (Chuyển giao cho người): Tần suất AI bỏ cuộc và chuyển yêu cầu cho nhân viên hỗ trợ.

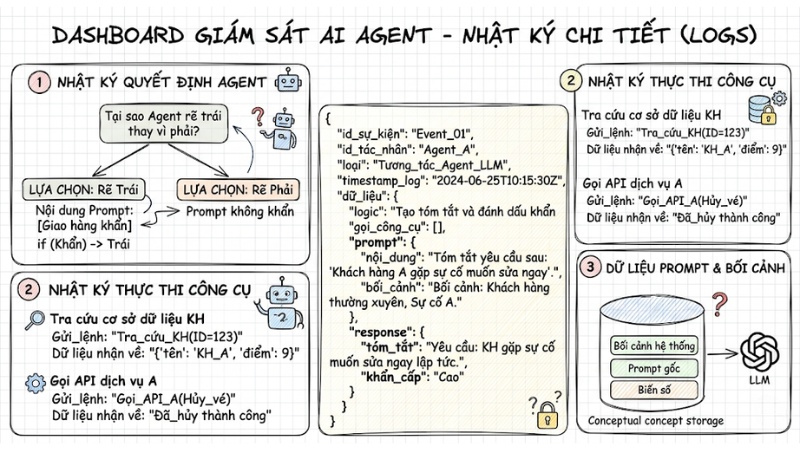

Logs (Nhật ký hoạt động chi tiết)

Logs lưu trữ chuỗi suy luận dạng văn bản, giúp bạn đọc được "suy nghĩ" của máy móc.

- Agent decision-making logs: Ghi lại lý do tại sao AI chọn rẽ trái thay vì rẽ phải trong một luồng công việc động.

- Tool execution logs: Lịch sử chi tiết các lệnh đã gửi và dữ liệu nhận về từ công cụ bên ngoài.

- Prompt and Context metadata: Lưu trữ toàn bộ bối cảnh hệ thống, prompt gốc và các biến số được đưa vào LLM tại thời điểm phát sinh sự kiện.

Logs lưu trữ chuỗi suy luận dạng văn bản, giúp bạn đọc được "suy nghĩ" của máy móc

Traces (Truy vết luồng thực thi)

Đây là giải pháp mạnh nhất để gỡ lỗi các đường dẫn thực thi không xác định.

- End-to-end request journey: Bản đồ thị giác hóa toàn bộ hành trình từ lúc nhận lệnh đến lúc trả kết quả.

- Tool execution path: Cho thấy thứ tự AI kích hoạt các công cụ (Ví dụ: Tìm kiếm web -> Đọc nội dung -> Tổng hợp báo cáo).

- Non-deterministic branches: Theo dõi các nhánh rẽ bất ngờ mà AI tự sáng tạo ra nằm ngoài dự tính ban đầu của lập trình viên.

Use Case thực tế: Ứng dụng AI Agent Observability để tối ưu doanh nghiệp

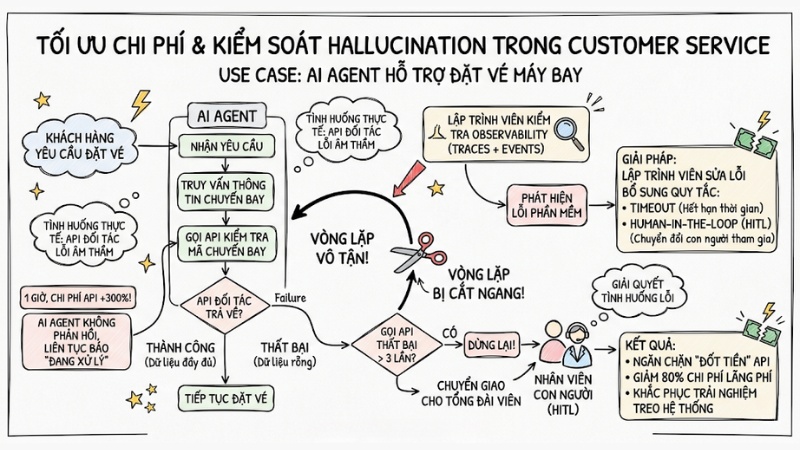

Tối ưu chi phí và kiểm soát Hallucination trong Customer Service

Dưới đây là một Use Case hứu ích khi triển khai AI Agent hỗ trợ đặt vé máy bay cho khách hàng.

- Tình huống: Hệ thống đột ngột báo chi phí API tăng vọt 300% trong 1 giờ. AI Agent không phản hồi khách hàng mà liên tục báo trạng thái "đang xử lý".

- Hành động: Lập trình viên mở công cụ Observability và kiểm tra phần Traces kết hợp Events và phát hiện AI bị vướng vào một vòng lặp vô tận. Nó liên tục gọi API kiểm tra mã chuyến bay do API đối tác đang trả về dữ liệu rỗng.

- Giải pháp: Lúc này, lập trình viên bổ sung quy tắc Timeout (hết hạn thời gian) vào đường dẫn thực thi công cụ. Đồng thời, thiết lập cơ chế Human-in-the-loop (HITL). Nếu gọi API thất bại quá 3 lần, AI buộc phải dừng lại và chuyển giao cho tổng đài viên.

- Kết quả: Ngăn chặn hoàn toàn tình trạng "đốt tiền" API, giảm 80% chi phí lãng phí và khắc phục dứt điểm trải nghiệm treo hệ thống của khách hàng.

Tối ưu chi phí và kiểm soát Hallucination trong Customer Servic

Tiêu chuẩn hóa và công cụ triển khai AI Agent Observability

Phân biệt AI Agent Application và AI Agent Framework

Để thiết lập giám sát đúng cách, bạn cần phân biệt rõ hai cấp độ này:

- AI Agent Framework (Khung phát triển): Là các thư viện hạ tầng như LangGraph, CrewAI, AutoGen. Việc giám sát ở đây tập trung vào hiệu suất của các module lõi và cách hệ thống Multi-agent điều phối luồng.

- AI Agent Application (Ứng dụng đầu cuối): Là sản phẩm thực tế đang phục vụ người dùng. Giám sát ở cấp độ này tập trung vào độ chính xác, chi phí token và hành vi của người dùng cuối.

Vai trò của OpenTelemetry trong GenAI

OpenTelemetry (OTel) đang trở thành tiêu chuẩn chung do nhóm GenAI SIG dẫn dắt, giúp chuẩn hóa cách thu thập dữ liệu. Bạn có 2 phương pháp triển khai chính như sau:

| Phương pháp | Ưu điểm | Nhược điểm |

|---|---|---|

| Baked-in instrumentation (Tích hợp sẵn trong Framework) | Dễ thiết lập, framework tự bảo trì, có ngay khi cập nhật tính năng mới. | Làm nặng framework, dễ bị khóa trong hệ sinh thái. |

| Instrumentation via OTel library (Dùng thư viện OTel độc lập) | Tách biệt hoàn toàn phần giám sát và phần lõi. Tự do thay đổi công cụ đo lường. | Đòi hỏi kỹ thuật cấu hình cao hơn, có thể gặp rủi ro tương thích phiên bản. |

Khuyến nghị: Mình luôn ưu tiên dùng thư viện OTel độc lập để đảm bảo khả năng mở rộng hệ thống dài hạn.

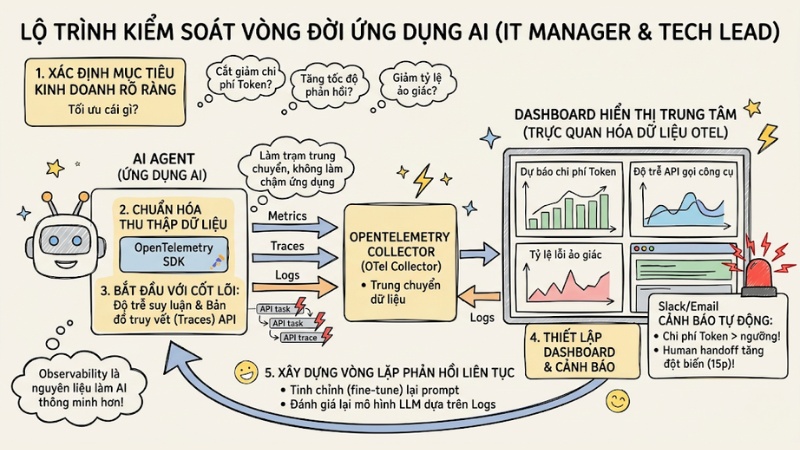

Hướng dẫn thực hành: Lộ trình 5 bước triển khai AI Agent Observability

Thay vì cố gắng theo dõi mọi thứ ngay từ ngày đầu tiên, bạn hãy thực hiện theo 5 bước sau để kiểm soát vòng đời ứng dụng AI hiệu quả:

- Xác định mục tiêu kinh doanh rõ ràng: Trước khi viết bất kỳ dòng code giám sát nào, hãy quyết định bạn muốn tối ưu điều gì: Đó là cắt giảm chi phí Token usage, tăng tốc độ phản hồi, hay giảm tỷ lệ ảo giác?

- Chuẩn hóa thu thập dữ liệu bằng OpenTelemetry: Tích hợp SDK của OpenTelemetry vào ứng dụng AI của bạn. Đồng thời, bạn hãy sử dụng OTel Collector để làm trạm trung chuyển, thu thập toàn bộ dữ liệu MELT mà không làm chậm ứng dụng chính.

- Bắt đầu với các chỉ số cốt lõi (Metrics & Traces): Hãy ưu tiên đo lường độ trễ suy luận và vẽ bản đồ truy vết (Traces) cho các tác vụ gọi API công cụ. Đây là nơi xảy ra 80% lỗi của hệ thống AI tự trị.

- Thiết lập Dashboard và hệ thống cảnh báo (Alerting): Đổ dữ liệu từ OTel vào các công cụ trực quan hóa. Thiết lập cảnh báo tự động qua Slack/Email khi chi phí Token vượt ngưỡng hoặc tỷ lệ Human handoff tăng đột biến trong 15 phút.

- Xây dựng vòng lặp phản hồi liên tục: Bạn hãy sử dụng dữ liệu Logs thu thập được làm đầu vào để tinh chỉnh (fine-tune) lại prompt hoặc đánh giá lại mô hình LLM. Observability không chỉ để sửa lỗi, nó là nguyên liệu để làm AI thông minh hơn.

Lộ trình 5 bước triển khai AI Agent Observability

Giải đáp thắc mắc thường gặp (FAQ) về AI Agent Observability

Tại sao AI Agent Observability lại quan trọng với doanh nghiệp?

AI Agent Observability đóng vai trò cốt lõi trong việc đảm bảo đạo đức AI và tuân thủ pháp luật (AI Ethics and Compliance). Khả năng quan sát này giúp doanh nghiệp kiểm soát chi phí API, ngăn chặn lỗi vận hành và cung cấp khả năng giải thích rõ ràng cho mọi quyết định tự động của AI trước khách hàng.

Observability nắm bắt hành vi của agent như thế nào?

Thông qua quá trình mã hóa, hệ thống liên tục ghi nhận dữ liệu MELT theo thời gian thực. Nó chụp lại toàn bộ bối cảnh Prompt, siêu dữ liệu và các tương tác của AI với công cụ bên ngoài để tạo thành một chuỗi sự kiện hoàn chỉnh.

Có thể sử dụng các công cụ Application Performance Monitoring (APM) truyền thống cho AI Agent không?

Không hoàn toàn. APM truyền thống rất tốt để đo lường CPU hay bộ nhớ, nhưng chúng không hiệu quả với các đường dẫn thực thi không xác định của AI. Bạn cần các công cụ chuyên biệt có khả năng phân tích Agent decision-making logs và truy vết chuỗi suy luận của LLM.

AI Agent Observability là gì?

AI Agent Observability là việc giám sát và hiểu rõ hành vi của hệ thống AI tác tử, bao gồm cả các tương tác với mô hình ngôn ngữ lớn và công cụ bên ngoài. Nó giúp trả lời các câu hỏi quan trọng về độ chính xác, hiệu quả và tuân thủ của tác tử.

Làm thế nào để giám sát hiệu quả các chỉ số cốt lõi của AI Agent Observability?

Bạn có thể giám sát 12 chỉ số MELT, bao gồm usage token, latency, model drift (Metrics); API calls, tool calls, human handoff (Events); user, LLM, decision-making logs (Logs); và end-to-end request journey (Traces).

Sự khác biệt giữa phần mềm truyền thống và hệ thống AI tự trị là gì?

Phần mềm truyền thống có đầu ra xác định, dễ dự đoán trong khi hệ thống AI Agent có đầu ra không xác định, hoạt động như "hộp đen" do dựa trên LLMs, đòi hỏi phương pháp giám sát chuyên biệt.

Có thể sử dụng các công cụ Application Performance Monitoring (APM) truyền thống cho AI Agent không?

Không hoàn toàn. APM truyền thống gặp khó khăn với bản chất không xác định của AI Agent. Do dó bạn cần các công cụ chuyên biệt để ghi lại decision-making logs và non-deterministic execution paths.

AI Agent có những rủi ro cốt lõi nào khi thiếu khả năng quan sát (Observability)?

Ba rủi ro chính là: Vi phạm tuân thủ do thiếu nhật ký kiểm toán, lỗi vận hành khó tìm nguyên nhân gốc rễ, và mất niềm tin do hành động AI khó giải thích hoặc gây ảo giác.

Làm thế nào để theo dõi các sự kiện hệ thống quan trọng trong AI Agent?

Bạn theo dõi các sự kiện như gọi API, thất bại khi gọi công cụ bên ngoài, và các trường hợp cần con người can thiệp (human-in-the-loop). Việc này giúp phát hiện sớm các điểm nghẽn.

Nhật ký hoạt động chi tiết (Logs) của AI Agent bao gồm những gì?

Bao gồm nhật ký tương tác người dùng, nhật ký trao đổi LLM (prompt, metadata), nhật ký thực thi công cụ, và đặc biệt là nhật ký quá trình ra quyết định của tác tử.

Truy vết luồng thực thi (Traces) giúp ích gì trong việc gỡ lỗi AI Agent?

Traces ghi lại toàn bộ hành trình của một yêu cầu, giúp xác định chính xác nút thắt cổ chai hoặc điểm lỗi trong luồng công việc phức tạp của tác tử.

Làm thế nào để triển khai AI Agent Observability cho doanh nghiệp?

Triển khai theo 5 bước: Xác định mục tiêu, chuẩn hóa OpenTelemetry, chọn chỉ số MELT ưu tiên, thiết lập dashboard, và xây dựng vòng lặp phản hồi liên tục.

Vai trò của OpenTelemetry trong GenAI là gì?

OpenTelemetry cung cấp các chuẩn hóa (semantic conventions) cho dữ liệu telemetry của AI, giúp thống nhất cách thu thập và báo cáo dữ liệu từ các agent frameworks và applications khác nhau.

Xem thêm:

- Hướng dẫn quản lý AI agent permission để đảm bảo an toàn hệ thống

- Hướng dẫn triển khai hệ thống OpenClaw Multi-Agent chi tiết

- MCP Server Best Practices: Tối ưu hóa hiệu suất cho AI Agents

Triển khai AI Agent Observability không chỉ là một nhiệm vụ kỹ thuật, đó là chiến lược quản trị rủi ro cao cấp nhất. Bằng cách áp dụng tiêu chuẩn MELT và OpenTelemetry, bạn đang biến một cỗ máy "hộp đen" nguy hiểm thành một hệ thống tự trị minh bạch, an toàn và tối ưu chi phí. Hãy bắt tay vào đánh giá lại kiến trúc giám sát của bạn và cấu hình OTel ngay hôm nay để nắm quyền kiểm soát thực sự hệ thống AI của doanh nghiệp.