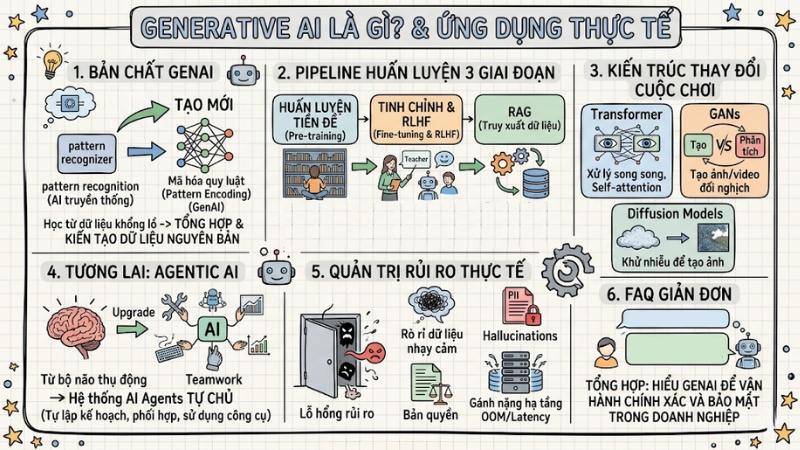

Generative AI là gì? Các ứng dụng thực tế của Generative AI

Generative AI (AI Tạo sinh) là một nhánh của trí tuệ nhân tạo tập trung vào việc tạo ra dữ liệu hoàn toàn mới dựa trên các quy luật đã học từ tập dữ liệu khổng lồ. Thay vì chỉ phân tích dữ liệu có sẵn, Generative AI tổng hợp các yếu tố để đưa ra kết quả nguyên bản dựa trên các câu lệnh của người dùng. Trong bài viết này, mình sẽ bóc tách chi tiết luồng hoạt động bên dưới, các kiến trúc cốt lõi và những rủi ro thực sự của công nghệ này khi áp dụng vào môi trường thực tế.

Những điểm chính

- Bản chất Generative AI: Hiểu rõ sự dịch chuyển từ Pattern Recognition (Nhận diện mẫu - AI truyền thống) sang Pattern Encoding (Mã hóa quy luật - GenAI), cho phép máy tính tổng hợp và kiến tạo dữ liệu nguyên bả.

- Pipeline huấn luyện 3 giai đoạn: Nắm vững lộ trình từ Pre-training (học nền tảng từ Internet), Fine-tuning & RLHF (tinh chỉnh hành vi) đến RAG (truy xuất dữ liệu thực tế) để đưa AI vào vận hành doanh nghiệp một cách chính xác.

- Kiến trúc thay đổi cuộc chơi: Hiểu cơ chế Transformer (xử lý song song bằng Self-attention), GANs (đối nghịch để tạo ảnh/video) và Diffusion Models (khử nhiễu để tạo ảnh) – nền tảng tạo nên sức mạnh của các model hiện đại.

- Tương lai Agentic AI: Định nghĩa lại vai trò của GenAI: từ một "bộ não thụ động" (chỉ trả lời khi được hỏi) chuyển sang hệ thống AI Agents tự chủ (tự lập kế hoạch, phối hợp nhóm, sử dụng công cụ thực thi) để giải quyết các quy trình phức tạp.

- Quản trị rủi ro thực tế: Đối diện thẳng thắn với các lỗ hổng: Ảo giác (Hallucinations), rò rỉ dữ liệu nhạy cảm (PII), bản quyền nội dung và gánh nặng hạ tầng (OOM/Latency) khi scale quy mô lớn.

- Giải đáp FAQ: Làm rõ sự khác biệt giữa AI dự đoán và AI tạo sinh, tầm quan trọng của RAG trong việc giảm ảo giác, và các chiến lược bảo mật hệ thống khi triển khai AI Agents trong doanh nghiệp.

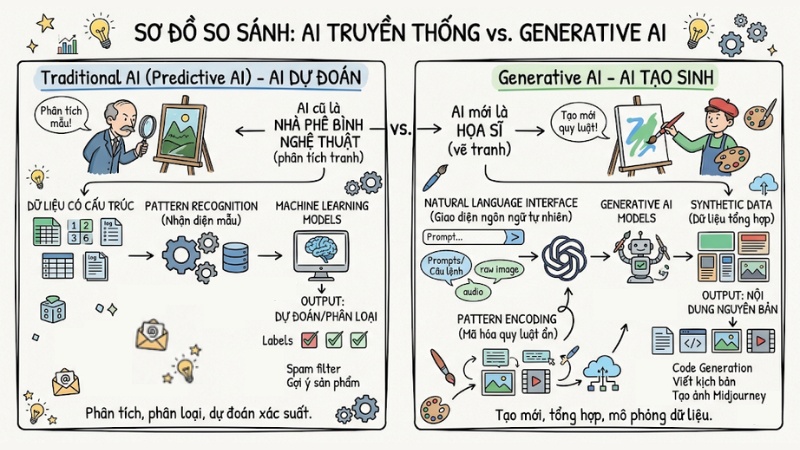

Generative AI là gì? Sự khác biệt cốt lõi với AI truyền thống

Để hiểu bản chất của Generative AI, chúng ta cần nhìn lại cách AI đã vận hành trong thập kỷ qua. Các mô hình Machine Learning truyền thống (Predictive AI) được xây dựng dựa trên nguyên lý Pattern Recognition (Nhận diện mẫu). Chúng được huấn luyện để tìm ra quy luật từ dữ liệu, sau đó đưa ra nhãn dán hoặc dự đoán xác suất. Ví dụ: Dự đoán giá nhà, phân loại email rác.

Ngược lại, AI tạo sinh đánh dấu sự chuyển dịch sang Pattern Encoding (Mã hóa quy luật ẩn). Hệ thống không dừng lại ở việc nhận diện, mà dùng các quy luật đó để tạo ra Synthetic Data (Dữ liệu tổng hợp) hoàn toàn mới. Nếu AI truyền thống phân tích dữ liệu giống như một nhà phê bình nghệ thuật phân tích tranh, thì Generative AI tạo ra nội dung mới giống như một họa sĩ vẽ tranh.

Hơn nữa, trong khi AI truyền thống đòi hỏi dữ liệu đầu vào có cấu trúc chặt chẽ (bảng biểu, thông số), thì GenAI hoạt động qua một giao diện ngôn ngữ tự nhiên), cho phép giao tiếp bằng ngôn ngữ đời thường.

Dưới đây là bảng so sánh generative AI và AI truyền thống, giúp bạn có góc nhìn tổng quan:

| Tiêu chí | AI truyền thống | Generative AI |

| Mục đích cốt lõi | Phân tích, phân loại và dự đoán xác suất. | Tạo mới, tổng hợp và mô phỏng dữ liệu. |

| Dữ liệu đầu vào (Input) | Dữ liệu có cấu trúc (số liệu, bảng, log file). | Ngôn ngữ tự nhiên (Prompts), hình ảnh, âm thanh thô. |

| Dữ liệu đầu ra (Output) | Kết quả nhị phân, điểm số, hoặc nhãn dán. | Nội dung nguyên bản: Text, Code, Image, Video. |

| Ví dụ thực tế | Hệ thống Spam filter, gợi ý sản phẩm, dự báo thời tiết. | Code Generation (Copilot), viết kịch bản, tạo ảnh (Midjourney). |

So sánh generative AI và AI truyền thống

Dù mạnh mẽ, GenAI không thể thay thế AI truyền thống. Với các bài toán đòi hỏi tính toán tuyến tính, chấm điểm tín dụng hay phát hiện gian lận tài chính, Predictive AI vẫn giữ vai trò độc tôn nhờ độ chính xác tuyệt đối.

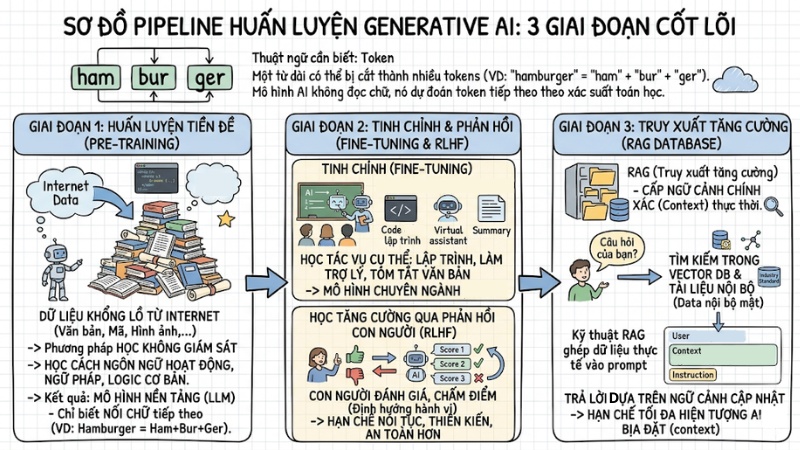

Bóc tách cách Generative AI hoạt động: 3 giai đoạn cốt lõi

Làm thế nào một mô hình máy tính có thể viết code Python hay làm thơ? Bí mật nằm ở một pipeline huấn luyện khổng lồ.

Thuật ngữ cần biết: Token là đơn vị tính toán cơ sở của văn bản. Một từ dài có thể bị cắt thành nhiều tokens (VD: "hamburger" = "ham" + "bur" + "ger"). Mô hình AI không đọc chữ cái theo cách con người hiểu, mà nó dự đoán token tiếp theo dựa trên xác suất toán học.

Quy trình huấn luyện một mô hình Generative AI tiêu chuẩn bao gồm 3 giai đoạn chính như sau:

Huấn luyện tiền đề

Đây là giai đoạn tạo ra các mô hình nền tảng hay LLM. Quá trình này áp dụng phương pháp học không giám sát trên một lượng dữ liệu khổng lồ từ Internet. Hãy tưởng tượng phương pháp này giống như việc một đứa trẻ tiếp cận một thư viện lớn nhất thế giới và đọc tất cả sách.

Mô hình sẽ học cách ngôn ngữ hoạt động, ngữ pháp, logic cơ bản và cách thế giới vận hành. Tuy nhiên, ở giai đoạn này, mô hình chỉ có khả năng dự đoán từ tiếp theo, chưa thể trả lời câu hỏi hoặc tuân thủ mệnh lệnh.

Tinh chỉnh và phản hồi

Mô hình nền tảng cần được đào tạo chuyên ngành.

- Tinh chỉnh (Fine-tuning): Sử dụng Training Data (dữ liệu có nhãn, chất lượng cao) để dạy AI cách thực hiện tác vụ cụ thể: Cách lập trình, cách làm trợ lý ảo hay cách tóm tắt văn bản.

- Cơ chế RLHF (Học tăng cường qua phản hồi con người): Con người sẽ đánh giá và chấm điểm các câu trả lời của AI để định hướng hành vi, giúp mô hình giảm thiểu phát ngôn không phù hợp, tránh thiên kiến và đưa ra câu trả lời an toàn hơn.

RAG (Truy xuất tăng cường)

Một mô hình LLM thông thường chỉ biết những gì nó được học tại thời điểm huấn luyện, nên không thể tự động truy cập vào dữ liệu mật, tài liệu nội bộ hay thông tin mới phát sinh trong doanh nghiệp bạn.

Kỹ thuật RAG hiện đã trở thành tiêu chuẩn trong ngành. Khi bạn đặt câu hỏi, hệ thống sẽ tìm và lấy ra các dữ liệu liên quan, sau đó đưa phần thông tin đó vào cùng với prompt để bắt buộc mô hình dựa trên nguồn dữ liệu thực tế mà trả lời. Nhờ vậy, RAG giúp bổ sung ngữ cảnh theo thời gian thực và giảm tối đa tình trạng AI bịa đặt hoặc suy diễn sai thông tin.

Bóc tách cách Generative AI hoạt động: 3 giai đoạn cốt lõi

3 kiến trúc mô hình "thay đổi cuộc chơi" của GenAI

Để tạo ra các Deep Learning Models mạnh mẽ, phần cứng (GPU) là chưa đủ. Các đột phá về thuật toán kiến trúc mới là thứ mở ra kỷ nguyên này.

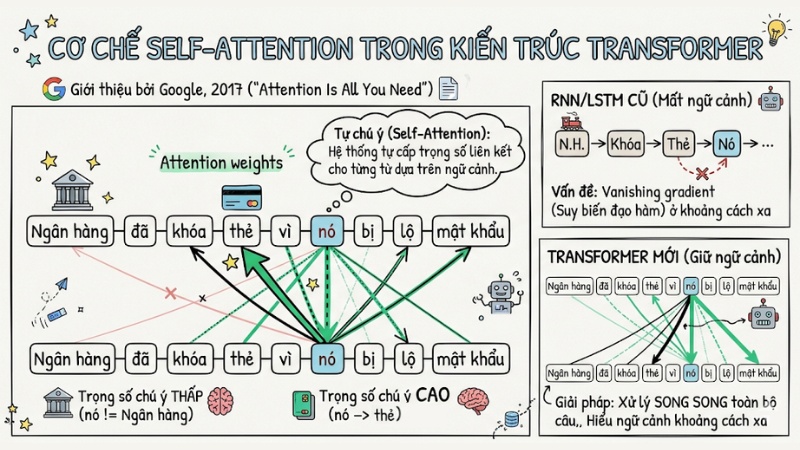

Kiến trúc Transformer

Được Google giới thiệu năm 2017 qua báo cáo khoa học "Attention Is All You Need", Transformer đã trở thành nền tảng cốt lõi của mọi mô hình ngôn ngữ hiện tại (như GPT, Claude, Llama).

Thay vì xử lý văn bản tuần tự từng từ một, kiến trúc Transformer cho phép mô hình xử lý song song toàn bộ chuỗi đầu vào, với trọng tâm là cơ chế Self-attention (Tự chú ý), giúp mô hình hiểu được mối liên hệ giữa các từ trong câu một cách hiệu quả hơn.

Hãy hình dung một câu dài: "Ngân hàng đã khóa thẻ vì nó bị lộ mật khẩu". Cơ chế Self-attention giúp hệ thống hiểu từ "nó" ở đây đang ám chỉ "thẻ" chứ không phải "ngân hàng" bằng cách gán trọng số liên kết giữa các từ khóa. Khả năng theo dõi ngữ cảnh ở khoảng cách xa này đã phá vỡ rào cản Vanishing gradient (suy biến đạo hàm) của các thế hệ AI trước.

Sơ đồ đơn giản hóa cơ chế Self-Attention của Transformer

Generative Adversarial Networks (GANs)

GANs là kiến trúc xuất sắc trong việc tạo ra hình ảnh, video giả lập. Nó bao gồm hai mạng Neural Networks hoạt động đối nghịch nhau:

- Generator (Bộ phận tạo sinh): Cố gắng tạo ra dữ liệu giả (ví dụ: ảnh khuôn mặt người) sao cho giống thật nhất.

- Discriminator (Bộ phận phân biệt): Có nhiệm vụ phân biệt đâu là dữ liệu thật từ tập huấn luyện, đâu là dữ liệu giả do Generator tạo ra.

Hai mạng này liên tục "chiến đấu" và học hỏi lẫn nhau. Generator ngày càng vẽ giỏi hơn, còn Discriminator ngày càng tinh mắt hơn. Quá trình này sẽ dừng lại khi ảnh giả chân thực đến mức "Cảnh sát" không thể phân biệt được nữa.

Mô hình khuếch tán (Diffusion Models)

Nếu bạn từng dùng Stable Diffusion hay Midjourney thì thực ra bạn đang sử dụng các mô hình Diffusion. Kiến trúc này hoạt động dựa trên hai bước chính: thêm nhiễu (noise) và khử nhiễu (denoising).

Hệ thống sẽ lấy một bức ảnh gốc và “phá hủy” nó bằng cách liên tục thêm nhiễu vào các pixel cho tới khi chỉ còn lại một màn nhiễu tĩnh vô nghĩa. Sau đó, mô hình học cách đảo ngược quy trình: Bắt đầu từ khung hình toàn nhiễu, dần dần khử nhiễu để tạo ra một bức ảnh hoàn chỉnh mới, được dẫn hướng bởi câu lệnh văn bản (prompt) mà bạn nhập vào.

Ứng dụng của công nghệ của Generative AI

- Hệ sinh thái Multi-modal (Đa phương thức): AI không chỉ xử lý text. Các model mới có thể nhận diện âm thanh trực tiếp, phân tích biểu đồ từ file ảnh, hoặc tạo video hướng dẫn từ một kịch bản văn bản.

- Tăng tốc chu kỳ phát triển phần mềm: Tạo boilerplate code, chuyển đổi mã nguồn giữa các ngôn ngữ (VD: từ Java sang Golang), viết unit tests tự động.

- Tự động hóa dữ liệu: Extract thông tin từ hàng nghìn file PDF hóa đơn không có cấu trúc và parse thành định dạng JSON chuẩn xác.

Mặt trái của công nghệ của Generative AI

Khả năng ứng dụng của Generative AI vào luồng vận hành doanh nghiệp là không thể phủ nhận. Tuy nhiên, đi kèm với lợi ích là những rủi ro bảo mật hệ thống nghiêm trọng.

- Ảo giác AI (AI Hallucinations): Đây là lỗi hệ thống lớn nhất. AI có thể đưa ra thông tin sai lệch về số liệu tài chính hoặc tạo ra các thư viện code không tồn tại. Chính vì vậy mà bạn bắt buộc phải có cơ chế Human-in-the-loop (con người kiểm duyệt) khi ứng dụng.

- Rò rỉ dữ liệu: Việc đưa mã nguồn nội bộ hoặc dữ liệu khách hàng (PII) lên các API công khai (không mã hóa) đồng nghĩa với việc bạn đang cung cấp dữ liệu của doanh nghiệp để huấn luyện mô hình cho nhà cung cấp.

- Bản quyền: Rủi ro pháp lý phát sinh khi kết quả đầu ra của AI chứa các đoạn mã hoặc hình ảnh có bản quyền từ nguồn dữ liệu huấn luyện (ví dụ: các vụ kiện liên quan đến The New York Times hoặc GitHub Copilot).

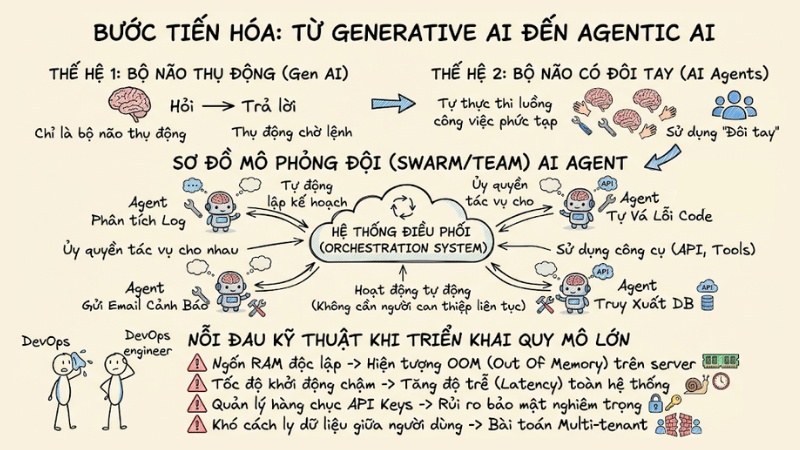

Bước tiến hóa tất yếu: Từ Generative AI đến Agentic AI

Một mô hình ngôn ngữ lớn (LLM) đơn lẻ, dù có thông minh đến đâu, cũng chỉ đóng vai trò là một “bộ não” thụ động: bạn hỏi, nó trả lời. Để thực thi các quy trình phức tạp trong doanh nghiệp, như tự động phân tích log hệ thống, truy xuất cơ sở dữ liệu, gửi email cảnh báo và tự động sửa lỗi mã nguồn, bộ não đó cần có công cụ hành động. Đó chính là sự ra đời của AI Agents.

Hệ sinh thái Agentic AI là nơi nhiều AI Agents làm việc theo nhóm (Swarm/Team), tự động lập kế hoạch, ủy quyền tác vụ cho nhau và sử dụng công cụ (tools) mà không cần sự can thiệp liên tục của con người.

Tuy nhiên, khi các DevOps Engineer triển khai một đội quân Agent quy mô lớn, những bài toán kỹ thuật nhức nhối lập tức xuất hiện:

- Mỗi Agent khi hoạt động độc lập tiêu tốn một lượng lớn bộ nhớ RAM, có thể dẫn đến lỗi hết bộ nhớ (Out Of Memory - OOM) trên máy chủ.

- Tốc độ khởi động chậm làm tăng độ trễ (latency) của toàn hệ thống.

- Quản lý hàng chục API Keys giữa các Agent dễ dẫn đến rủi ro bảo mật nghiêm trọng.

- Khó khăn trong việc cách ly dữ liệu giữa các luồng người dùng (multi-tenant).

Để giải quyết những vấn đề này, doanh nghiệp cần một nền tảng orchestration cho Agentic AI đủ nhẹ, đủ nhanh và bảo mật để vận hành cả “đội quân” agent ở quy mô lớn một cách an toàn.

Đội AI Agent giao tiếp với nhau qua hệ thống Orchestration

Câu hỏi thường gặp về Generative AI

Generative AI là gì và sự khác biệt chính của nó là gì?

Generative AI (AI tạo sinh) là loại trí tuệ nhân tạo có khả năng tự tạo ra nội dung mới như văn bản, hình ảnh, mã nguồn từ dữ liệu đã học. Khác với AI truyền thống chỉ dừng lại ở việc dự đoán hoặc phân loại dữ liệu, Generative AI tập trung vào việc mô phỏng quy luật để kiến tạo dữ liệu hoàn toàn mới.

Sự khác biệt giữa AI truyền thống và Generative AI là gì?

AI truyền thống (Predictive AI) tập trung vào nhận diện mẫu để đưa ra dự báo (ví dụ: phát hiện email spam). Ngược lại, Generative AI sử dụng các mô hình học sâu để mã hóa quy luật, từ đó tạo ra nội dung mới. Do đó, nên chọn Predictive AI cho các bài toán tối ưu hóa xác suất, và chọn Generative AI cho các bài toán sáng tạo nội dung.

Làm thế nào để Generative AI giảm thiểu tình trạng "ảo giác" (hallucination)?

Để giảm thiểu ảo giác, các kỹ sư thường sử dụng kỹ thuật RAG. Thay vì chỉ dựa vào kiến thức nội tại đã được huấn luyện của mô hình, hệ thống sẽ truy xuất dữ liệu thực tế từ các nguồn đáng tin cậy trước khi yêu cầu AI tổng hợp câu trả lời, giúp đảm bảo độ chính xác cao hơn.

Tại sao Transformer Architecture lại là nền tảng của các LLM hiện nay?

Kiến trúc Transformer sử dụng cơ chế "Self-Attention" cho phép mô hình xử lý dữ liệu song song và hiểu được mối quan hệ ngữ cảnh giữa các từ ở xa nhau trong một câu. Nhờ đó, nó vượt trội hoàn toàn so với các kiến trúc trước đây trong việc xử lý văn bản quy mô lớn.

Có những rủi ro bảo mật nào khi triển khai AI Agents trong doanh nghiệp?

Rủi ro chính bao gồm rò rỉ dữ liệu nhạy cảm qua API, nguy cơ bị tấn công Prompt Injection để chiếm quyền điều khiển, và các vấn đề về bản quyền nội dung. Doanh nghiệp cần triển khai các hệ thống cách ly, mã hóa API key nghiêm ngặt và các biện pháp bảo mật khác để đảm bảo an toàn.

Tại sao doanh nghiệp nên chuyển dịch từ LLM đơn lẻ sang Agentic AI?

Một LLM đơn lẻ chỉ là "bộ não" thụ động. Trong khi đó, Agentic AI (hệ thống các AI agent phối hợp) cho phép tự động hóa các quy trình công việc phức tạp, bao gồm lập kế hoạch, thực thi nhiệm vụ và tự sửa lỗi, giúp tăng năng suất vượt trội so với việc chỉ sử dụng chatbot đơn thuần.

Xem thêm:

- Low-code là gì? Tìm hiểu về kiến trúc kỹ thuật và rủi ro tiềm ẩn

- MCP Transport là gì? Tìm hiểu cơ chế truyền tải của Model Context Protocol

- AIaaS là gì? Tìm hiểu chi tiết về Artificial Intelligence as a Service

Tóm lại, Generative AI đã tái định nghĩa kiến trúc phần mềm với khả năng sáng tạo và tổng hợp dữ liệu vượt trội. Tuy nhiên, để đưa AI từ môi trường thử nghiệm (POC) vào vận hành thực tế tại doanh nghiệp, việc thiết lập một đội ngũ Agentic AI mới là đích đến cuối cùng. Đây là bước chuyển từ “một bộ não thông minh” sang “một hệ thần kinh tự động hành động”, giúp doanh nghiệp khai thác tối đa giá trị của AI ở quy mô sản xuất.